Tác giả: Trần Hoàng Giang

Tóm tắt

Trong kỷ nguyên số hóa, sự tương tác giữa con người và máy tính (Human-Computer Interaction – HCI) đang trải qua một bước chuyển mình lịch sử: từ các lệnh logic nhị phân sang sự thấu hiểu cảm xúc. Điện toán Cảm xúc (Affective Computing – AC), và điện toán cảm xúc ứng dụng (applied affective computing – AAC) một lĩnh vực tiên phong kết hợp Khoa học máy tính, Tâm lý học và Khoa học Thần kinh, đang hiện thực hóa khả năng trang bị “Trí tuệ cảm xúc” (EQ) cho máy móc.

Bài viết này cung cấp một cái nhìn sơ lược về lịch sử, các mô hình lý thuyết, các ACC từ những đột phá công nghệ mới nhất năm 2024-2025 (như Vision Transformers và Multimodal LLMs), cũng như phân tích sâu về các ứng dụng thực tiễn và thách thức đạo đức từ Đạo luật AI của Châu Âu cho lãnh vực AC.

1. Nguồn gốc và định nghĩa AC: Từ MIT Media Lab đến thế giới

Mặc dù ý tưởng về những cỗ máy có cảm xúc đã xuất hiện từ lâu trong khoa học viễn tưởng, nhưng Điện toán Cảm xúc – AC chỉ thực sự trở thành một ngành khoa học chính thống vào năm 1997.

Thuật ngữ “Affective Computing – AC” được phổ biến bởi Giáo sư Rosalind Picard của MIT Media Lab qua bài báo khoa học năm 1995 và cuốn sách cùng tên xuất bản năm 1997. Nơi cuốn sách mang tính nền tảng Affective Computing này, giáo sư Rosalind Picard lập luận rằng trí thông minh thực sự không thể tách rời khỏi cảm xúc. Các nghiên cứu thần kinh học cho thấy những người bị tổn thương vùng não cảm xúc thường mất khả năng đưa ra các quyết định hợp lý, minh chứng rằng cảm xúc đóng vai trò then chốt trong nhận thức và ra quyết định (Picard, 1997).

Do đó, mục tiêu của lĩnh vực này là trao cho máy móc trí tuệ cảm xúc, bao gồm khả năng mô phỏng sự đồng cảm và điều chỉnh hành vi của máy móc dựa trên trạng thái cảm xúc của người dùng.

2. Cơ sở lý thuyết: Làm sao để “số hóa” cảm xúc?

Để máy tính hiểu được cảm xúc, các trạng thái tâm lý trừu tượng phải được chuyển đổi thành dữ liệu định lượng. Các hệ thống AC hiện đại dựa trên hai luồng lý thuyết tâm lý học chính:

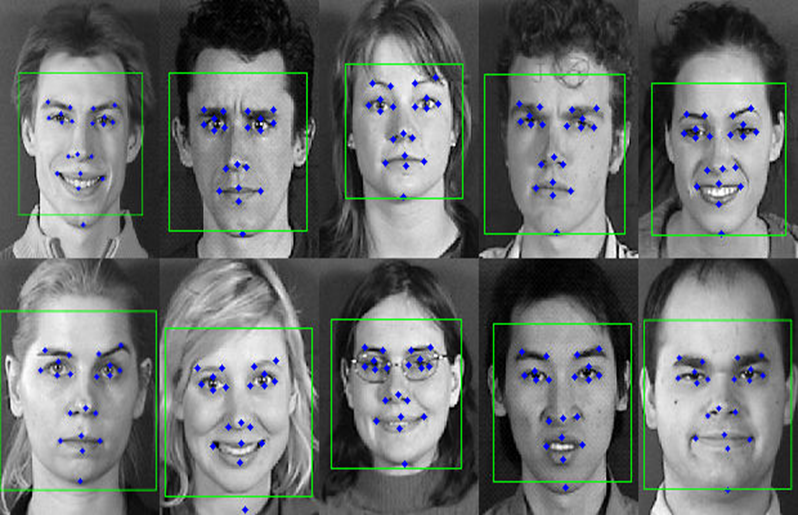

Phát hiện các đặc điểm hình học tĩnh trên khuôn mặt – Nguồn: https://www.interaction-design.org/

- Mô hình Phân loại Cảm xúc – Lý thuyết cảm xúc rời rạc (Categorical Theory): Charles Darwin là một trong những tác giả đầu tiên viết về cảm xúc. Ông đóng vai trò quan trọng trong việc nghiên cứu chúng thông qua cuốn sách năm 1872 của mình, ” Sự biểu hiện của cảm xúc ở người và động vật” – Ông cho rằng tất cả con người đều thể hiện những cảm xúc này thông qua biểu cảm khuôn mặt.

Tuy nhiên, ngày nay chúng ta dựa trên nghiên cứu của Paul Ekman, mô hình này phân loại cảm xúc thành 6 nhóm cơ bản mang tính phổ quát: Vui, Buồn, Giận, Sợ, Ghê tởm, và Ngạc nhiên. Đây là nền tảng cho các hệ thống phân loại đơn giản hiện nay. Vào những năm 1990, Ekman đã mở rộng danh sách này để bao gồm cả các cảm xúc tích cực và tiêu cực khác như: sự thích thú, khinh thường, mãn nguyện, xấu hổ, tội lỗi, tự hào về thành tích, nhẹ nhõm, và khoái cảm giác quan (Ekman, 1992).

- Mô hình Liên tục/chiều kích (Continuous/Dimensional Approach): Tiêu biểu là Mô hình vòng (Circumplex model) của James A. Russell. Mô hình này lập luận rằng cảm xúc không độc lập mà liên quan với nhau trong một không gian hai chiều gồm: Sự hài lòng (pleasure-displeasure) và Mức độ kích thích (arousal-sleepiness) James Russell cho rằng cảm xúc không phải là các hộp riêng biệt mà là các điểm tọa độ trong không gian liên tục, được xác định bởi trục Hóa trị (Valence) (Tích cực – Tiêu cực) và trục Kích thích (Arousal) (Tĩnh lặng – Kích động). Mô hình này cho phép máy tính đo lường được sắc thái và cường độ cảm xúc tinh tế hơn (Russell, 1980).

Khi ứng dụng công nghệ trong lĩnh vực ACC, mô hình vòng (cách tiếp cận liên tục) thường được sử dụng song song hoặc đối chiếu với cách tiếp cận phân loại (Categorical approach – sử dụng các lớp rời rạc như vui, buồn, giận..). Mô hình liên tục này cho phép máy móc gán nhãn dữ liệu (như giọng nói hoặc biểu cảm khuôn mặt) dựa trên các giá trị hồi quy liên tục của sự tiêu cực/tích cực và mức độ kích thích/bình tĩnh, thay vì chỉ phân loại vào một nhóm cố định

3. Các công nghệ cốt lõi cho AC: Bước nhảy vọt của AI (2024-2025)

Sự bùng nổ của Học sâu (Deep Learning – DL) đã thay đổi hoàn toàn năng lực của AC. Các hệ thống Affective Computing sử dụng cảm biến thụ động để thu thập dữ liệu và các thuật toán học máy để phân tích như các công nghệ chính yếu sau:

3.1. Thị giác máy tính: Sự trỗi dậy của Vision Transformers (ViT)

Nhận diện qua khuôn mặt (Facial Affect Detection): Sử dụng camera để bắt các biểu cảm vi mô. Hệ thống Mã hóa Hành động Khuôn mặt (FACS) phân tích sự co giãn của các nhóm cơ cụ thể (Action Units) để xác định cảm xúc.

Trong khi Mạng nơ-ron tích chập (CNN) như ResNet từng là tiêu chuẩn vàng, năm 2024 đánh dấu sự chuyển dịch sang Vision Transformers (ViT). Khác với CNN chỉ tập trung vào các đặc điểm cục bộ (như khóe miệng, đuôi mắt), ViT sử dụng cơ chế “Sự chú ý” (Self-Attention) để nắm bắt mối quan hệ toàn cục trên khuôn mặt, giúp nhận diện chính xác các vi biểu cảm (micro-expressions) thoáng qua mà mắt thường khó phát hiện (Tian et al., 2024).

3.2. Xử lý Giọng nói: Học tự giám sát (Self-Supervised Learning)

Nhận diện qua giọng nói (Speech Emotion Recognition – SER): Phân tích các đặc điểm âm thanh như cao độ, tốc độ và năng lượng. Các cảm xúc như giận dữ thường có cao độ cao và nhanh, trong khi buồn bã thường chậm và trầm.

Thách thức lớn nhất của nhận diện cảm xúc qua giọng nói là thiếu dữ liệu gán nhãn. Các mô hình Học tự giám sát như HuBERT và Wav2Vec 2.0 của Meta AI đã giải quyết vấn đề này bằng cách học cấu trúc âm thanh từ hàng ngàn giờ ghi âm không nhãn, sau đó tinh chỉnh (fine-tuning) cho nhiệm vụ cảm xúc. Kết quả cho thấy HuBERT vượt trội hơn các phương pháp truyền thống trong việc phân tách cảm xúc khỏi nội dung lời nói (Jafarzadeh et al., 2024).

3.3. Giám sát sinh lý học:

Sử dụng cảm biến đeo được để đo nhịp tim (BVP), độ dẫn điện của da (EDA/GSR) hoặc điện cơ mặt (EMG) để phát hiện sự thay đổi trong hệ thần kinh tự chủ liên quan đến cảm xúc,,.

3.4. Hợp nhất Đa phương thức (Multimodal Fusion)

Con người không chỉ “nhìn” hay “nghe” để hiểu cảm xúc, chúng ta kết hợp cả hai. Hệ thống AC tiên tiến nhất hiện nay sử dụng Hợp nhất Đa phương thức, kết hợp dữ liệu khuôn mặt, giọng nói và thậm chí cả tín hiệu sinh lý (nhịp tim, điện não đồ). Các kỹ thuật mới như Multimodal Prompt Learning đang giúp AI xử lý tình huống “mất tín hiệu” (ví dụ: khi khuôn mặt bị che khuất) bằng cách tự động bù đắp thông tin từ các kênh dữ liệu khác (Guo et al., 2024).

Tuy nhiên, thách thức lớn là vấn đề thiếu hụt dữ liệu (missing modalities) trong thực tế. Các phương pháp mới như Multimodal Prompt Learning đang được phát triển để phục hồi thông tin bị thiếu và cải thiện hiệu suất mô hình,.

4. Các ứng dụng thực tiễn của AC: Công nghệ phục vụ con người

Điện toán Cảm xúc đã vượt ra khỏi phòng thí nghiệm để đi vào đời sống như:

- Hỗ trợ Tự kỷ (Autism Therapy): Robot xã hội như Zeno hay NAO đang được sử dụng để dạy trẻ tự kỷ kỹ năng giao tiếp. Robot cung cấp môi trường tương tác an toàn, lặp lại và không phán xét, giúp trẻ tập luyện khả năng nhận biết cảm xúc (Pennisi et al., 2024).

- An toàn Giao thông (Automotive): Hệ thống giám sát người lái (Driver Monitoring Systems – DMS) sử dụng AI cảm xúc để phát hiện sự “xao nhãng nhận thức” (mắt mở nhưng không tập trung), buồn ngủ, hoặc cảm xúc tiêu cực của tài xế thông qua phân tích hướng nhìn và biểu cảm… từ đó nhằm cải thiện an toàn đường bộ (Smart Eye, 2024). Theo Quy định An toàn Chung (GSR) của EU, từ tháng 7/2024, các xe mới bắt buộc phải có hệ thống giám sát người lái (DMS).

- Sức khỏe Tâm thần số: Các thiết bị đeo được (như của Empatica) giúp theo dõi cơn động kinh hoặc mức độ căng thẳng. Robot xã hội hỗ trợ người già hoặc trẻ tự kỷ phát triển cảm xúc. Các ứng dụng khác như Ginger hay Talkspace sử dụng AI để phân tích giọng nói và văn bản của bệnh nhân, giúp bác sĩ theo dõi tiến trình điều trị trầm cảm theo thời gian thực (Spherical Insights, 2024).

- Giáo dục: Hệ thống có thể nhận biết khi học sinh chán nản hoặc bối rối để điều chỉnh nội dung giảng dạy phù hợp.

- Dịch vụ khách hàng: Phân tích cảm xúc trong các cuộc gọi để đánh giá hiệu suất nhân viên và sự hài lòng của khách hàng.

5. Đạo đức và Pháp lý: Những lằn ranh đỏ

Sự phát triển của AC đi kèm với những lo ngại sâu sắc về quyền riêng tư và sự công bằng.

- Thiên kiến Thuật toán (Bias): Sai lệch thuật toán (Algorithmic Bias) là hiện tượng các hệ thống trí tuệ nhân tạo (AI) tạo ra các kết quả không công bằng, mang tính phân biệt đối xử hoặc thiếu chính xác đối với các nhóm người dùng cụ thể. Các nghiên cứu như Gender Shades đã chỉ ra rằng nhiều hệ thống nhận diện cảm xúc hoạt động kém chính xác hơn đối với phụ nữ và người da màu do dữ liệu huấn luyện mất cân bằng (Buolamwini & Gebru, 2018; Krishnapriya et al., 2024).

- Đạo luật AI Châu Âu (EU AI Act): Đây là khung pháp lý nghiêm ngặt nhất thế giới hiện nay. Văn bản này trình bày Quy định (EU) 2024/1689, một khuôn khổ pháp lý toàn diện nhằm thiết lập các quy tắc hài hòa về trí tuệ nhân tạo trong phạm vi Liên minh Châu Âu. Cấu trúc của tài liệu tập trung vào việc phân loại các hệ thống AI dựa trên mức độ rủi ro, từ đó áp dụng các lệnh cấm đối với các thực hành không thể chấp nhận và đặt ra những tiêu chuẩn nghiêm ngặt cho các hệ thống AI có rủi ro cao;

Đạo luật (EU AI Act) này CẤM việc sử dụng AI để suy luận cảm xúc trong trường học và nơi làm việc, nhằm ngăn chặn việc giám sát quá mức và phân biệt đối xử dựa trên trạng thái tâm lý (EU Commission, 2024).

Về Tính riêng tư: Việc thu thập dữ liệu sinh trắc học từ xa (như nhận diện khuôn mặt thời gian thực) ở nơi công cộng bị hạn chế nghiêm ngặt và chỉ được phép trong các trường hợp thực thi pháp luật đặc biệt (EU AI Act – 35).

6. Kết luận

Điện toán Cảm xúc đang mở ra kỷ nguyên mới nơi công nghệ trở nên nhân văn hơn. Tuy nhiên, để công nghệ này thực sự là “Hạt Giống Số” tốt lành, chúng ta cần phát triển nó trên nền tảng của sự minh bạch, công bằng và tôn trọng phẩm giá con người. Tương lai không chỉ nằm ở việc máy móc thông minh đến đâu, mà là chúng có thể thấu cảm với chúng ta như thế nào.

Tài liệu Tham khảo

- Ekman, P. (1992). An argument for basic emotions. Cognition and Emotion, 6(3-4), 169–200.

- Picard, R. W. (1997). Affective Computing. MIT Press.

- Russell, J. A. (1980). A circumplex model of affect. Journal of Personality and Social Psychology, 39(6), 1161–1178.

- Buolamwini, J., & Gebru, T. (2018). Gender shades: Intersectional accuracy disparities in commercial gender classification. Proceedings of the 1st Conference on Fairness, Accountability and Transparency, 81, 77–91.

- EU Commission. (2024). Artificial Intelligence Act: Regulation (EU) 2024/1689 laying down harmonised rules on artificial intelligence. Publications Office of the European Union.

- Guo, Z., Jin, T., & Zhao, Z. (2024). Multimodal prompt learning with missing modalities for sentiment analysis and emotion recognition. Proceedings of the 62nd Annual Meeting of the Association for Computational Linguistics (pp. 1726–1736).

- Jafarzadeh, P., Rostami, A. M., & Choobdar, P. (2024). Speaker emotion recognition: Leveraging self-supervised models for feature extraction using Wav2Vec2 and HuBERT. arXiv preprint arXiv:2411.02964.

- Krishnapriya, K. S., Kushwaha, V., & King, M. C. (2024). Demographic bias in facial recognition: A survey. IEEE Transactions on Technology and Society.

- Pennisi, P., Tonacci, A., Tartarisco, G., & Billeci, L. (2024). Affective computing in child-robot interaction: A systematic review. IEEE Transactions on Affective Computing.

- Smart Eye. (2024). Driver monitoring system: The safety and convenience features of tomorrow. Smart Eye AB.

- Spherical Insights. (2024). Top 50 companies in mental health technology market in the world in 2025. Spherical Insights & Consulting.

- Tian, Y., Zhu, J., Yao, H., & Chen, D. (2024). Facial expression recognition based on vision transformer with hybrid local attention. Applied Sciences, 14(15), 6471.

- https://www.interaction-design.org/literature/topics/affective-computing